deepseek

大模型的训练过程需要耗费大量的计算资源(比如投入上亿元构建计算机集群去训练大模型),训练成本比较昂贵,个人是无法承担的。但是,训练得到的大模型,部署到计算机上,就不需要那么高的计算资源要求。但是,即使如此,在DeepSeek出现之前,很多市场上的大模型产品都是“贵族”模型,“段位”很高,通常需要依赖高端的硬件,配置大量的GPU,普通个人计算机一般很难运行大模型。

deepseek 简介

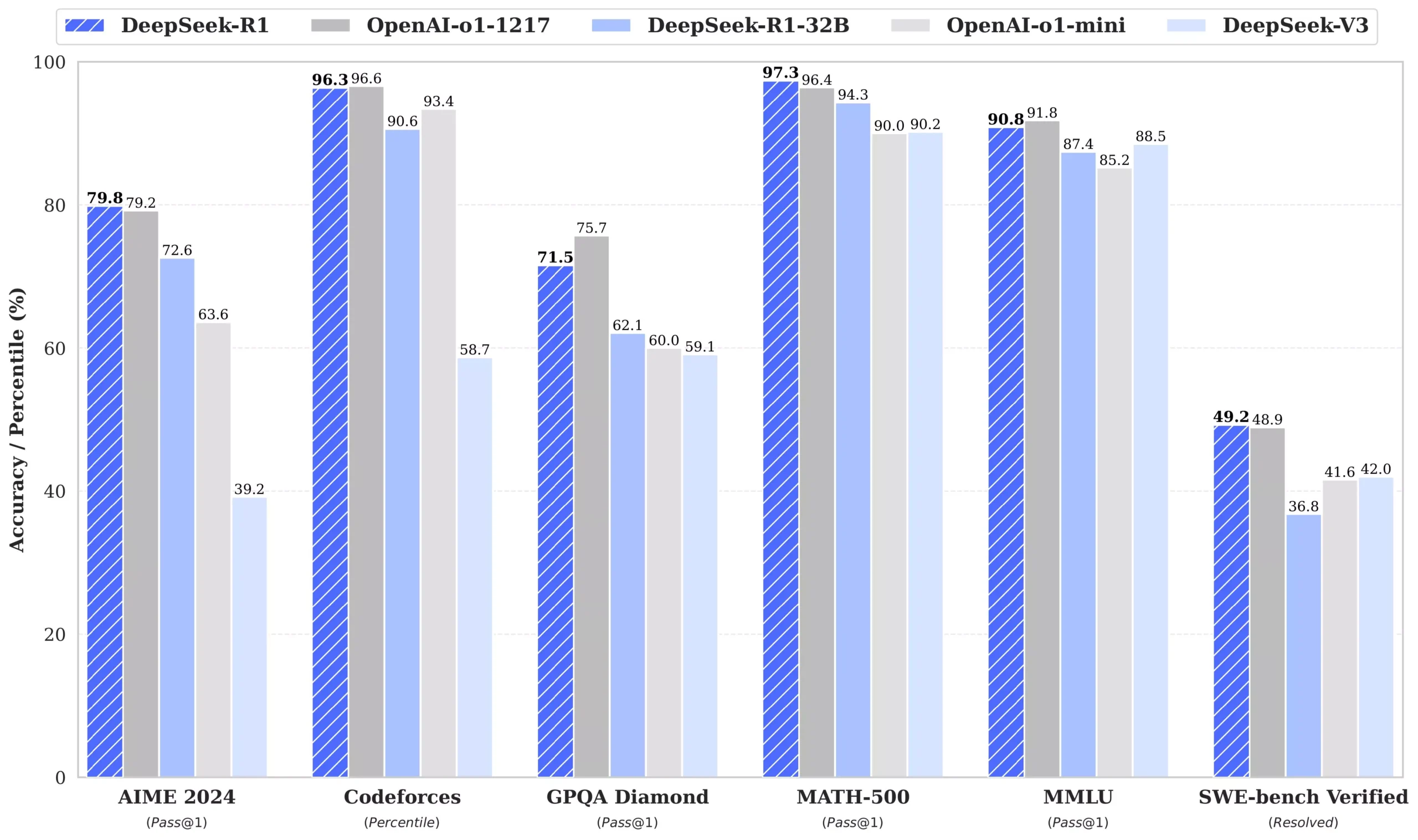

中国春节期间,DeepSeek爆火,国产开源大模型追平甚至超越了CloseAI的o1模型。

2025年1月20日,我国杭州深度求索公司的DeepSeek R1大模型正式发布,它是一个基于深度学习的推荐系统模型,通常用于处理推荐任务,如商品推荐、内容推荐等。Deepseek R1的发布,标志着大模型产品的“平民”时代已经到来,它大大降低了对计算机硬件的要求,可以部署在普通的个人计算机上,甚至部署在手机等便携式设备中。Deepseek采用了较为简洁高效的模型架构,去除了一些不必要的复杂结构和计算,在保证模型性能的基础上,降低了对计算资源的需求,使模型在本地计算机上运行更加轻松。通过先进的量化压缩技术,Deepseek将模型的参数进行压缩存储和计算,大大减少了模型所需的存储空间和计算量。2025年1月30日,微软公司宣布支持在Win11电脑本地运行DeepSeek R1大模型。

因此DeepSeek是一个专注于人工智能研究与应用的平台,致力于提供高效、灵活且易于部署的AI解决方案。DeepSeek R1是其最新版本,支持多种AI模型的本地部署,能够满足不同场景下的需求。https://www.deepseek.com/ 它具备以下特点:

- 轻量级:模型经过优化,适合在资源有限的设备上运行。

- 高效推理:能够在低延迟下进行实时推理。

- 可扩展性:支持自定义训练和微调,满足不同场景需求。

本地部署的必要性

在人工智能技术飞速发展的今天,本地部署AI模型成为越来越多开发者和企业关注的焦点。

既然网络可以正常使用 deepseek 为什么要本地部署呢?

搭建本地DeepSeek的优势和好处主要包括以下几点:

数据隐私与安全

本地部署确保数据始终存储在个人设备上,避免敏感信息上传至云端,降低数据泄露风险,尤其适合处理机密或隐私数据。

定制化与灵活性

本地搭建允许根据需求自定义模型参数、训练数据和功能,满足特定任务或领域的要求,提供更高的灵活性。

离线可用性

本地部署后,无需依赖网络连接即可使用,适合网络不稳定或无网环境,确保服务的持续可用性。

性能优化

本地运行可以充分利用硬件资源,减少网络延迟,提升处理速度,尤其适合处理大规模数据或复杂任务。

成本控制

长期来看,本地部署可能比依赖云服务更经济,避免持续的订阅费用,尤其适合高频使用场景。

研究与开发

本地搭建便于开发者深入研究和优化模型,进行实验和调试,适合学术研究或技术开发。

独立性

本地部署减少对第三方服务的依赖,避免因服务中断或政策变化导致的不可用问题。

总的来说,本地搭建DeepSeek在隐私、定制、性能、成本等方面具有显著优势,适合对数据安全、定制化需求高的用户。

部署步骤

接下来我详细介绍如何在本地部署DeepSeek R1,同时涵盖Ollama和Chatbox AI的安装与配置。通过这些步骤,你可以在本地环境中高效地运行和使用这些强大的AI工具。

安装 Ollama

Ollama是一个开源的本地化大模型部署工具,旨在简化大型语言模型(LLM)的安装、运行和管理。它支持多种模型架构,并提供与OpenAI兼容的API接口,适合开发者和企业快速搭建私有化AI服务。

访问Ollama官网(https://ollama.com/), 点击“Download”

,根据操作系统(Windows、macOS或Linux)下载自己操作系统对应的安装包,比如,Windows用户可以点击“Windows”图标,然后,点击“Download for Windows”下载安装包。需要注意的是,对于Windows系统,这里仅支持Windows10及其以上版本。

下载完成以后,

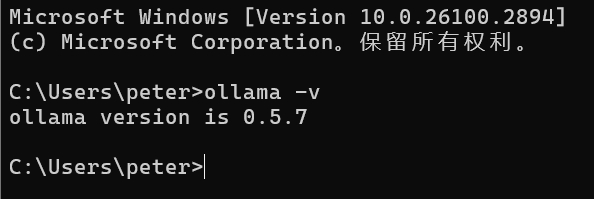

(1)对于Windows系统,双击安装包文件“OllamaSetup.exe”完成安装。安装完成后,在Windows系统中,右键单击开始菜单按钮,在弹出的菜单中选择“运行”,再在弹出的对话框中输入“cmd”并回车,打开cmd命令行工具窗口,输入以下命令验证是否安装成功:

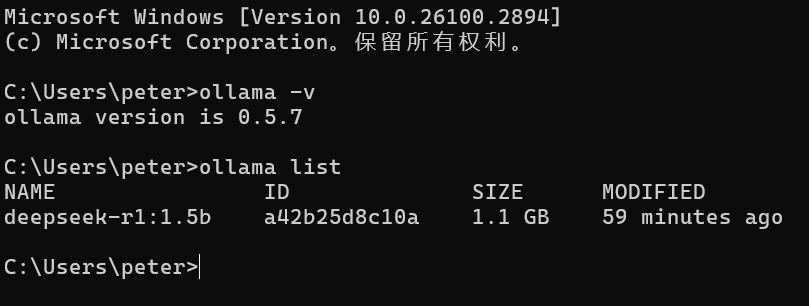

ollama --version

如果显示Ollama版本号,说明安装成功

(2)对于Linux系统,使用以下命令安装:

curl -fsSL https://ollama.com/install.sh | sh

运行以下命令查看是否安装成功:

ollama -v

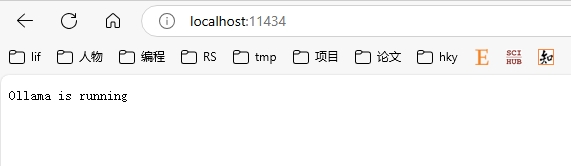

验证安装:打开浏览器,访问 http://localhost:11434 ,如果页面显示Ollama的界面,则说明安装成功。

下载DeepSeek R1

Ollama已经在第一时间支持DeepSeek R1,模型下载地址是https://ollama.com/library/deepseek-r1。 请根据自己的显存选择对应的模型,建议选择参数较少、体积最小的1.5B版本(如果计算机的配置较高,也可以选择参数较大的版本),这里的B是英文Billion(十亿),表示参数模型的参数规模,1.5B表示大模型的参数量是15亿。当然,我们可以不用到这个下载地址手动下载,只需要在cmd命令行窗口中执行如下命令就可以自动下载DeepSeek R1大模型:

ollama run deepseek-r1:1.5b

该命令会自动下载并加载模型,下载时间取决于网络速度和模型大小。

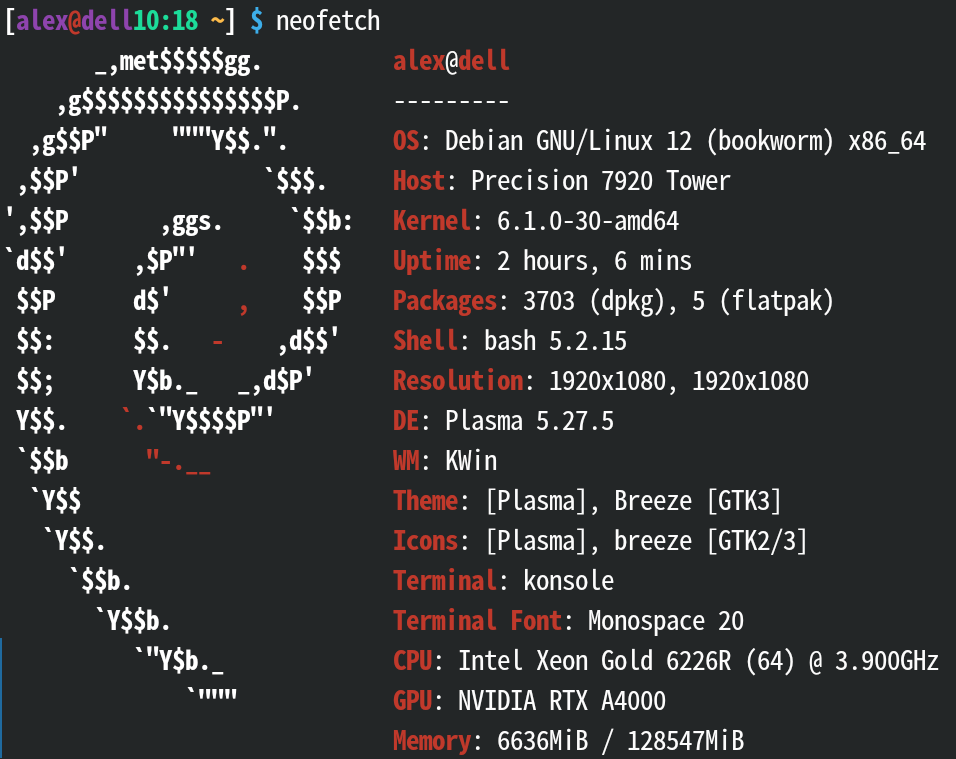

显存与模型对应关系

在本地部署DeepSeek模型时,显存和内存需求主要取决于模型的大小、批次以及是否使用量化技术。以下是1.5B、7B、8B、14B、32B、70B、671B等模型的大致需求:

1. 显存需求(FP16精度)

| 模型大小 | 显存需求(FP16) | 备注 |

|---|---|---|

| 1.5B | 6-8 GB | 适合中端显卡(如RTX 3060/2080) |

| 7B | 24-28 GB | 需要高端显卡(如RTX 3090/A100) |

| 8B | 28-32 GB | 需要高端显卡(如A100) |

| 14B | 48-56 GB | 需要专业级显卡(如A100 40GB/80GB) |

| 32B | 96-112 GB | 需要多卡或专业级显卡(如A100 80GB) |

| 70B | 200-240 GB | 需要多卡并行(如4x A100 80GB) |

| 671B | 1.5-2 TB | 需要大规模分布式计算(如多节点A100集群) |

2. 内存需求

| 模型大小 | 内存需求 | 备注 |

|---|---|---|

| 1.5B | 8-12 GB | 普通PC可满足 |

| 7B | 28-32 GB | 需要高内存配置 |

| 8B | 32-40 GB | 需要高内存配置 |

| 14B | 56-64 GB | 需要服务器级内存 |

| 32B | 112-128 GB | 需要服务器级内存 |

| 70B | 240-256 GB | 需要高端服务器内存 |

| 671B | 2-3 TB | 需要分布式内存系统 |

3. 量化技术的影响

通过量化技术(如8-bit或4-bit),可以显著降低显存需求:

- 8-bit量化:显存需求减少约50%

- 4-bit量化:显存需求减少约75%

例如:

- 7B模型(FP16):24-28 GB显存 → 4-bit量化后仅需6-7 GB显存。

- 14B模型(FP16):48-56 GB显存 → 4-bit量化后仅需12-14 GB显存。

4. 硬件推荐

- 1.5B模型:RTX 3060/2080(8-12 GB显存) + 16 GB内存。

- 7B模型:RTX 3090/A100(24-40 GB显存) + 32 GB内存。

- 14B模型:A100 40GB/80GB + 64 GB内存。

- 32B模型:多卡A100 80GB + 128 GB内存。

- 70B模型:4x A100 80GB + 256 GB内存。

- 671B模型:分布式多节点A100集群 + TB级内存。

5. 总结

- 1.5B:6-8 GB显存,8-12 GB内存。

- 7B:24-28 GB显存,28-32 GB内存。

- 8B:28-32 GB显存,32-40 GB内存。

- 14B:48-56 GB显存,56-64 GB内存。

- 32B:96-112 GB显存,112-128 GB内存。

- 70B:200-240 GB显存,240-256 GB内存。

- 671B:1.5-2 TB显存,2-3 TB内存。

根据硬件条件选择合适的模型和配置,量化技术可以显著降低资源需求。

下载完成后,可以使用以下命令查看模型信息:

ollama list

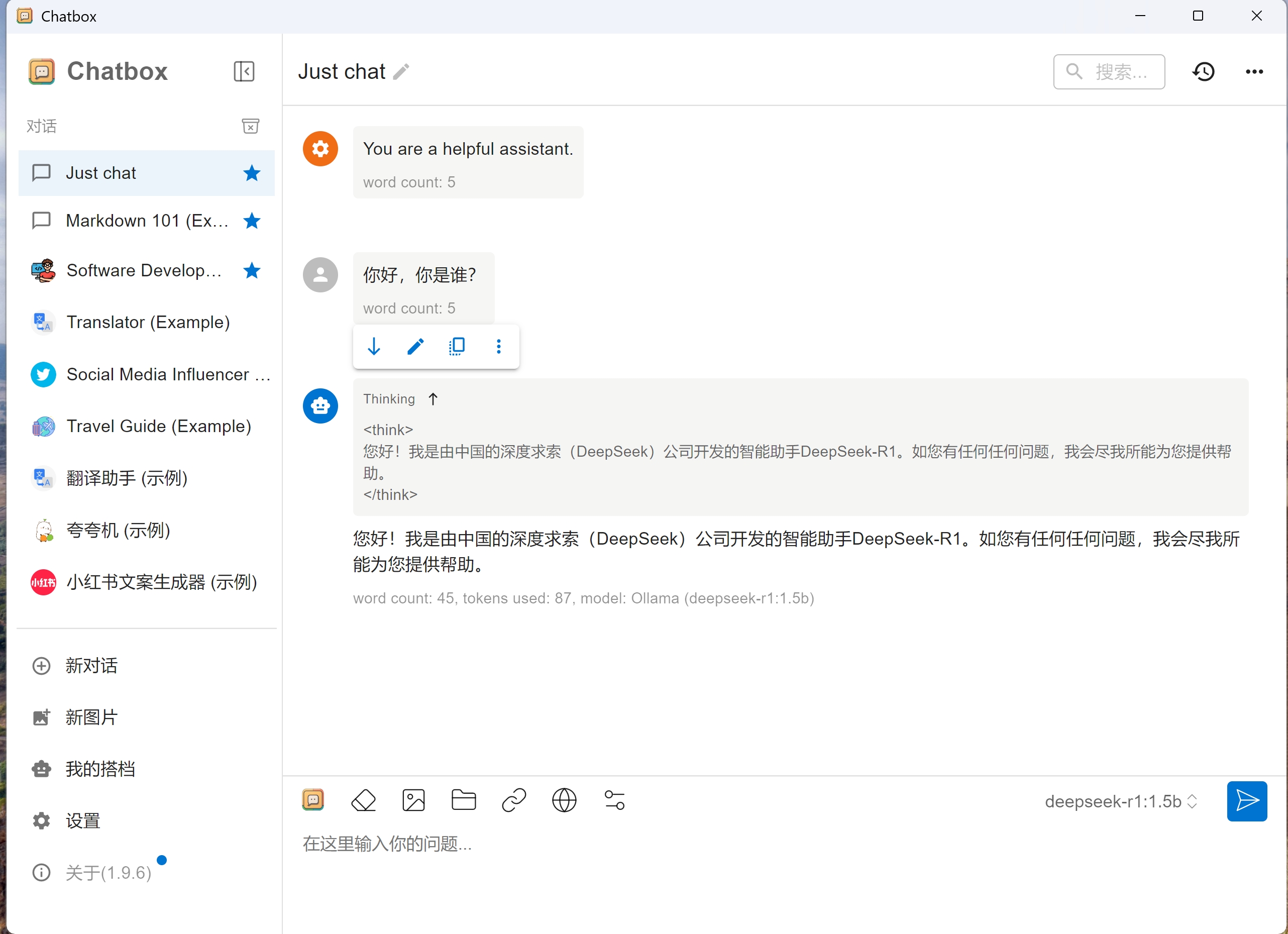

chatbox AI

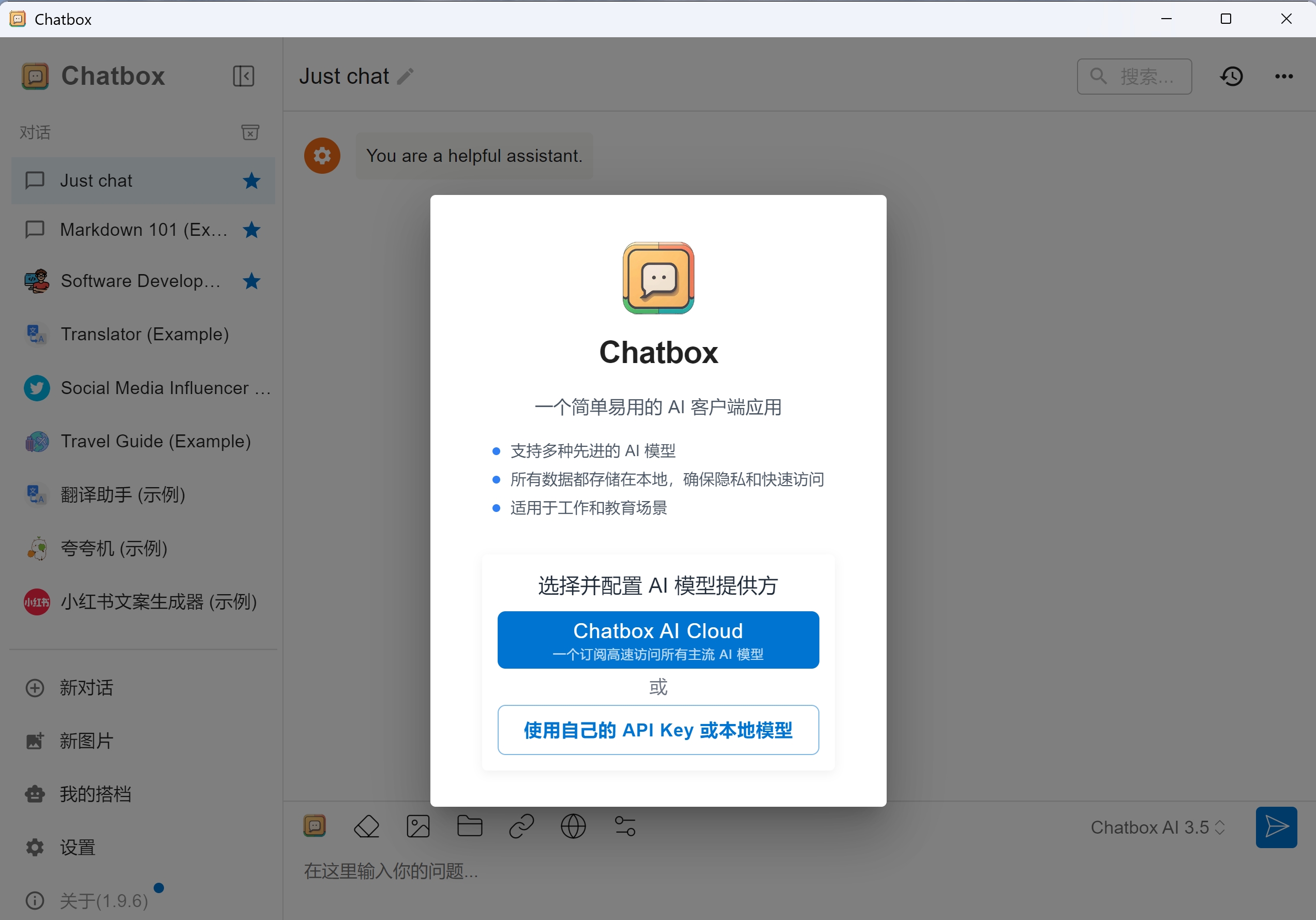

Chatbox AI是一个基于对话的AI平台,能够实现自然语言交互。它支持多种语言和场景,可以与Ollama和DeepSeek R1配合使用,提供更丰富的交互体验。以下是Chatbox AI的安装步骤:

下载Chatbox AI:访问Chatbox AI的官方网站,下载最新版本的安装包: https://chatboxai.app/zh

安装Chatbox AI:

(1)对于Windows系统,解压下载的文件,并运行安装程序。

(2)对于Linux系统,使用以下命令运行:

sudo ./Chatbox-1.9.5-x86_64.AppImage

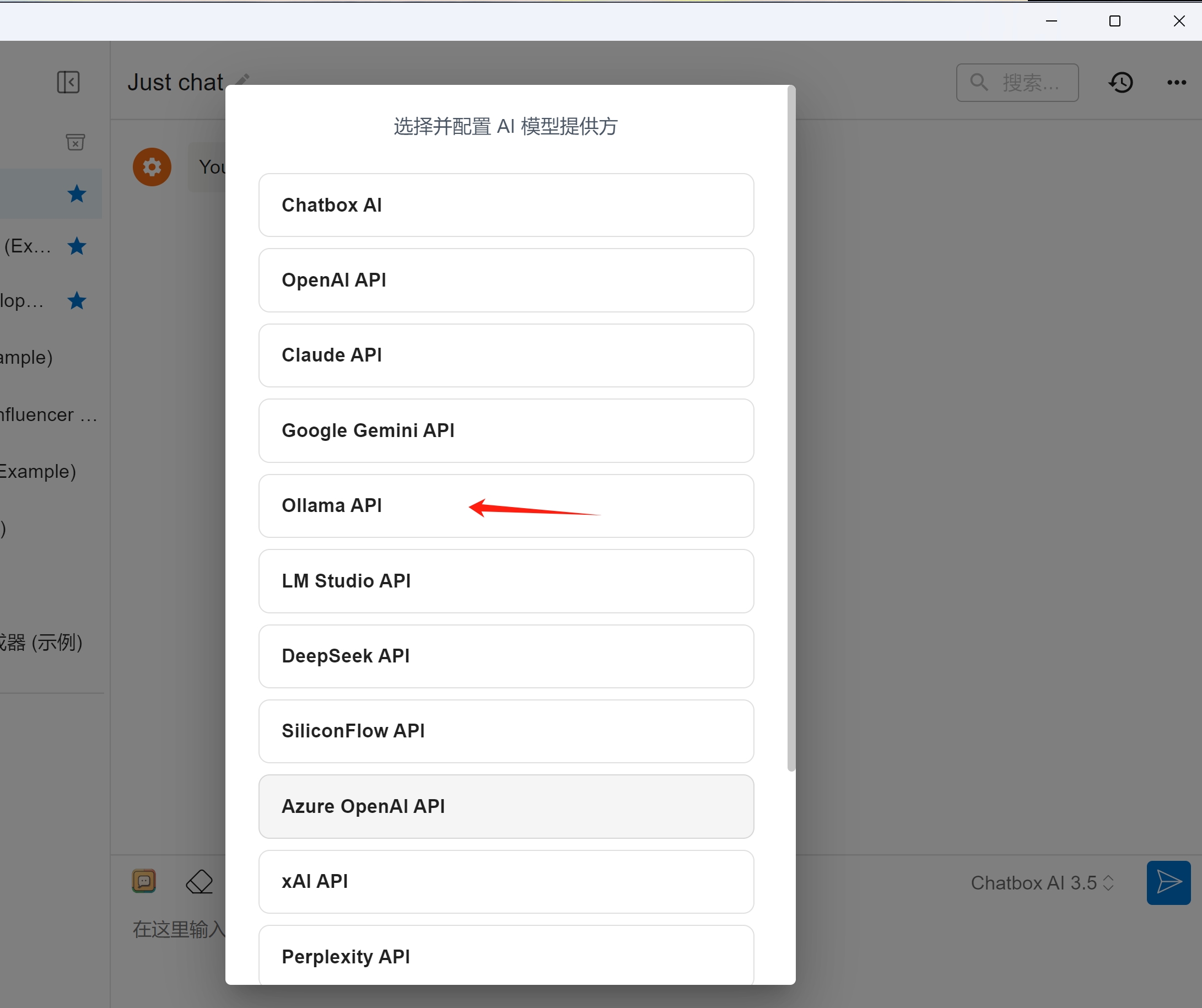

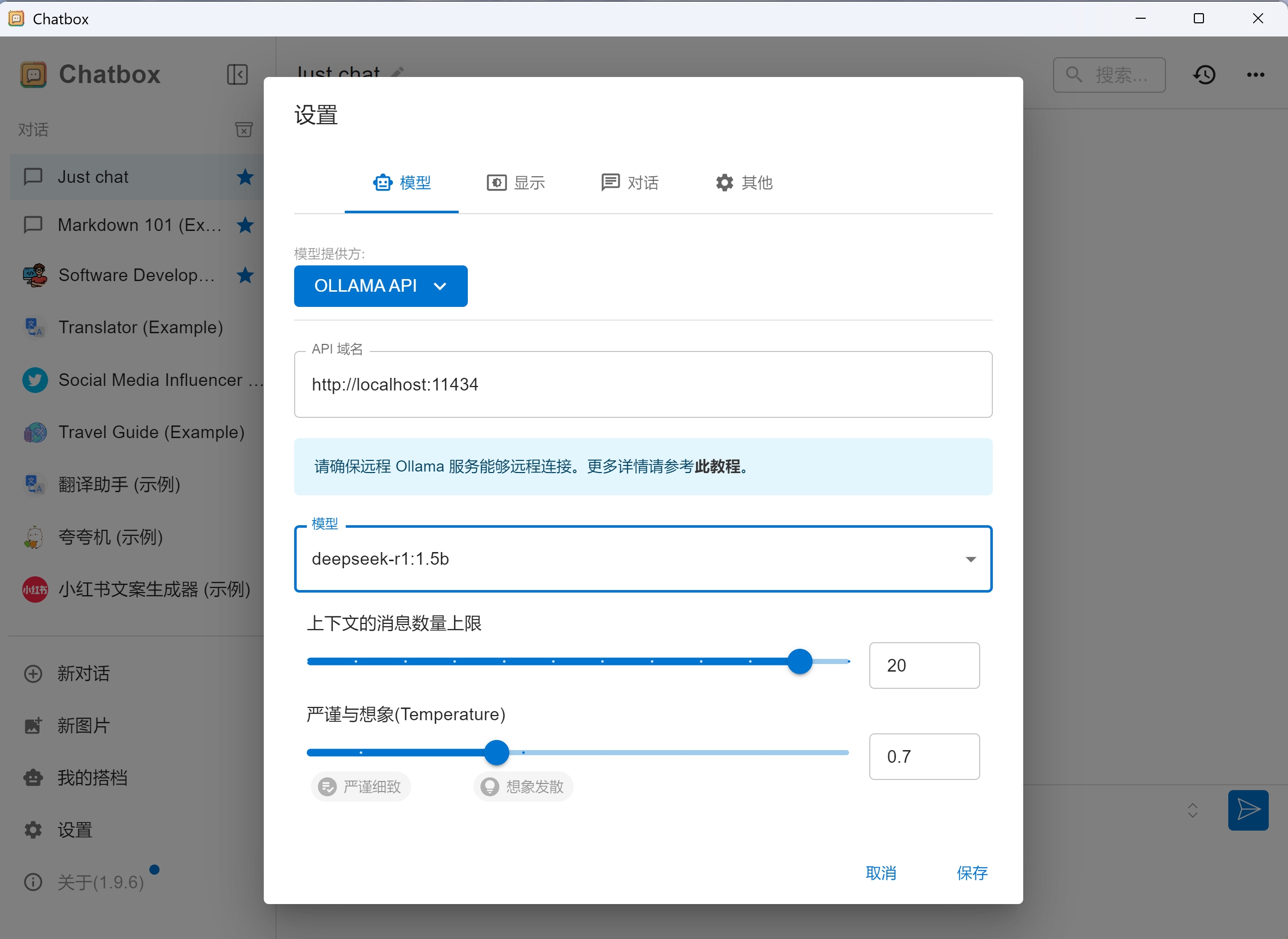

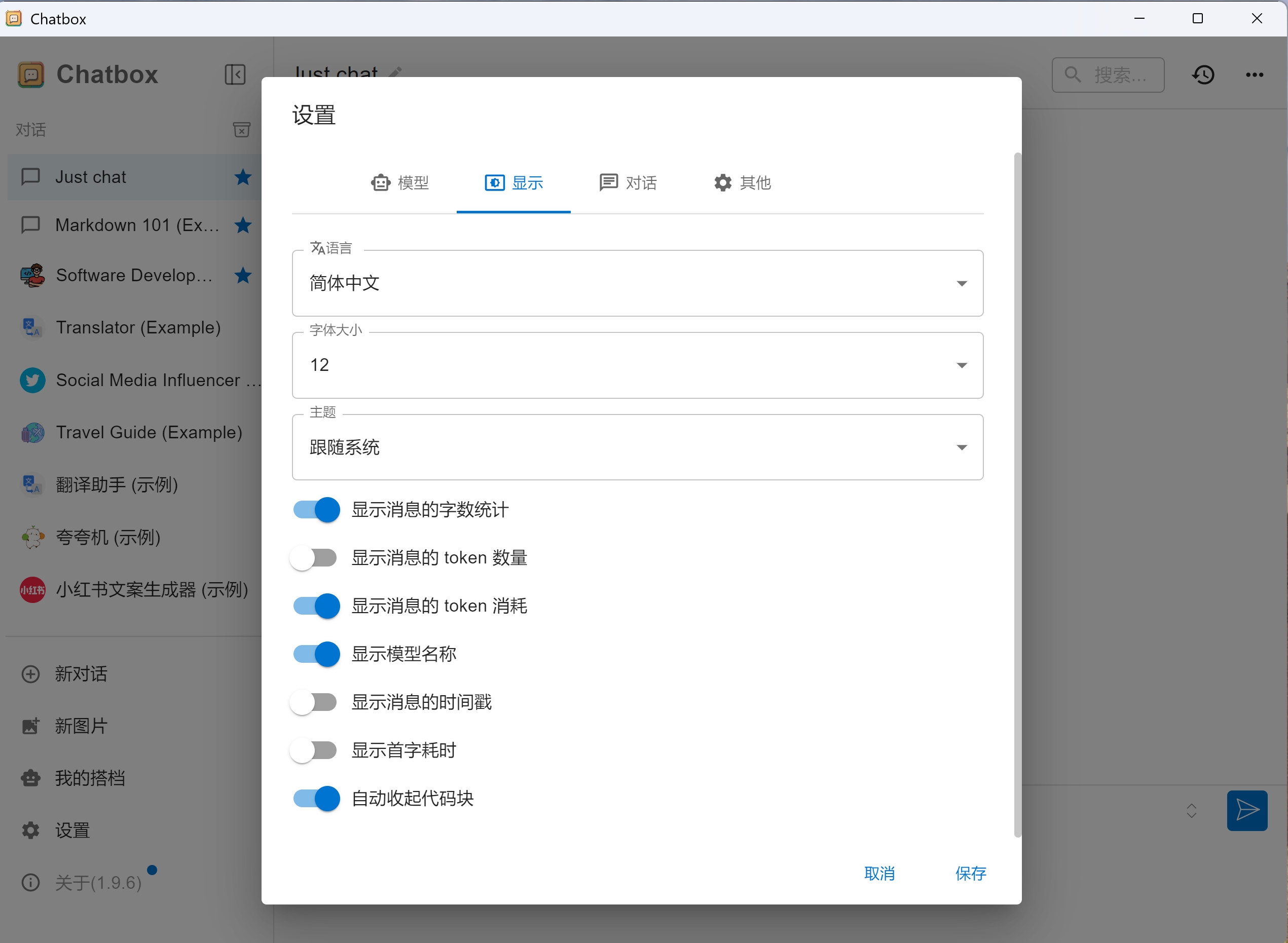

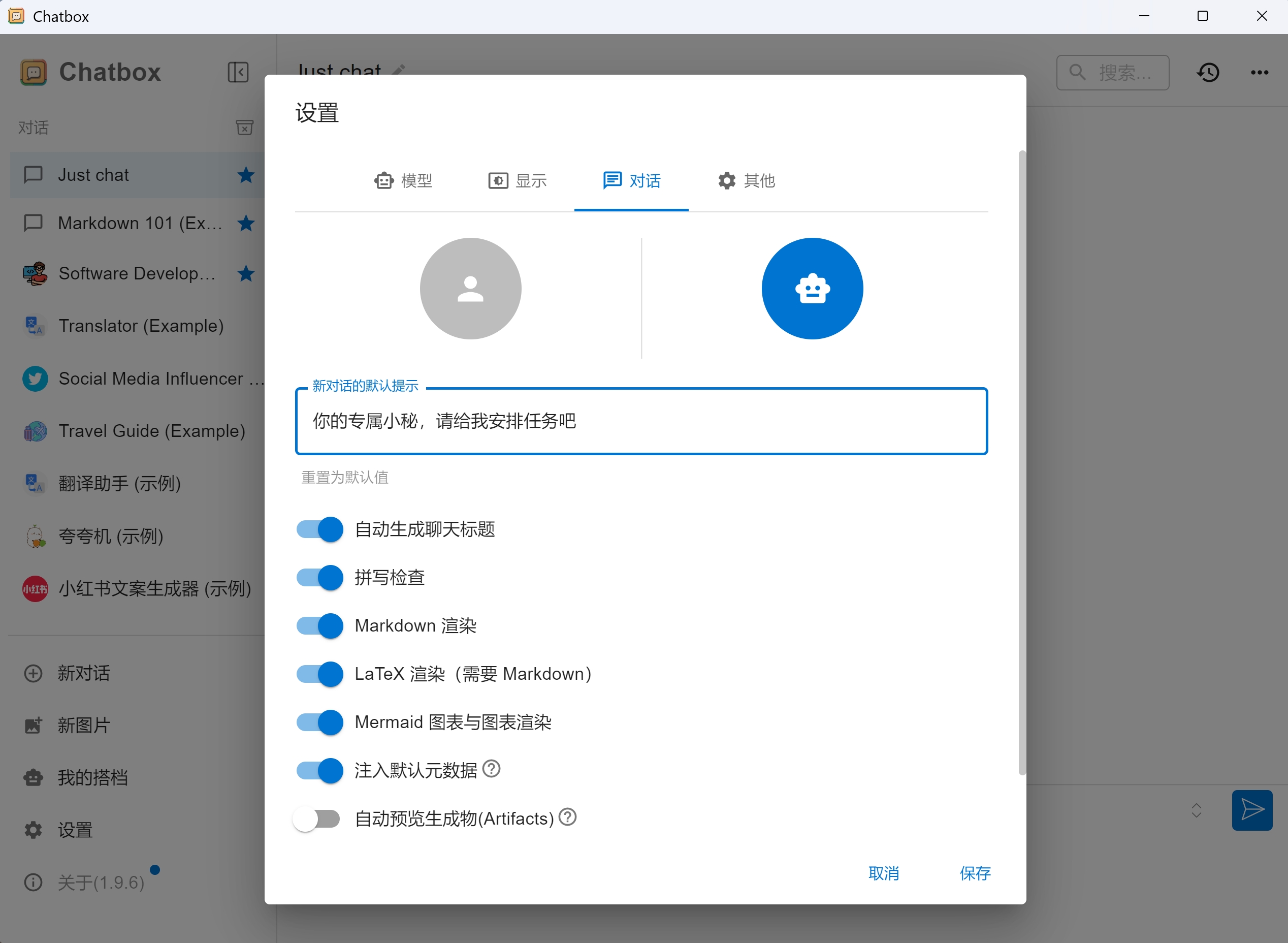

- 配置Chatbox AI:

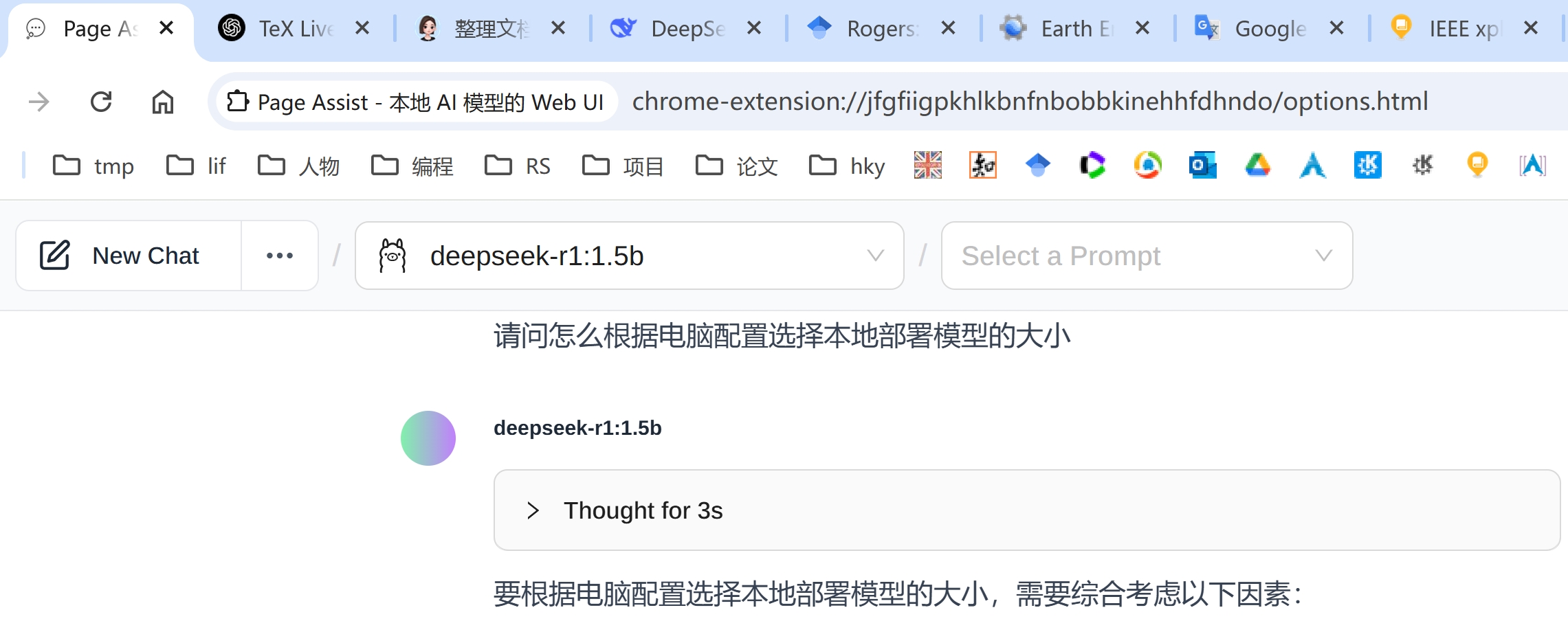

除了chatbox可以进行UI可视化之外,还可以用浏览器插件来实现,我们只需要安装一下page assist插件

安装到浏览器后直接打开即可自动链接已经下载的模型。

参考来源: